딥러닝 모델은 데이터를 입력받아 어떤 결과를 예측합니다.

그런데 이 예측이 정답과 얼마나 차이 나는지는 어떻게 판단할까요?

바로 손실 함수(Loss Function)가 그 역할을 합니다.

손실 함수는 모델의 예측이 얼마나 틀렸는지를 수치로 계산해주고,

이를 통해 딥러닝 모델은 스스로 가중치를 조정하며 똑똑해집니다.

이번 글에서는 가장 대표적인 손실 함수인 MSE(평균 제곱 오차)와 Cross-Entropy(교차 엔트로피)를 중심으로,

언제 어떤 상황에서 사용해야 하는지 쉽게 설명하겠습니다.

들어가기 앞서 아래 2개 글을 순서대로 읽어보고 오시는걸 추천합니다.

https://jdcyber.tistory.com/97

뉴럴 네트워크란 무엇인가? (NPU 개념 공부)

뉴럴 네트워크란 무엇인가?뉴럴 네트워크(Neural Network)는 인간의 뇌 구조에서 아이디어를 얻은 인공지능 모델입니다.쉽게 말해,인간의 뇌가 수많은 뉴런(신경 세포)들이 서로 연결되어 정보를 처

jdcyber.tistory.com

https://jdcyber.tistory.com/98

NPU를 위한 AI 기초 딥러닝의 핵심, 활성화 함수 완전 정복 (ReLU, Sigmoid, Tanh 차이와 선택 기준)

딥러닝을 공부하다 보면 반드시 마주치는 개념 중 하나가 바로 "활성화 함수(Activation Function)"입니다.입력값에 가중치를 곱하고, 편향을 더한 후, 그냥 바로 다음 층으로 전달하면 되는 것 아닌가

jdcyber.tistory.com

1. 손실 함수란 무엇인가?

💡 정의

- 예측값과 실제값 사이의 오차(차이)를 수치로 표현한 것

- 이 오차 값을 최소화하는 방향으로 모델을 학습하게 됨

🔁 작동 흐름

- 입력 데이터를 순전파 → 예측 결과 생성

- 정답과 비교해 손실 함수로 오차 계산

- 역전파로 가중치 조정 → 더 나은 예측 만들기

👉 손실 함수는 모델 학습의 ‘나침반’이라고 할 수 있어요.

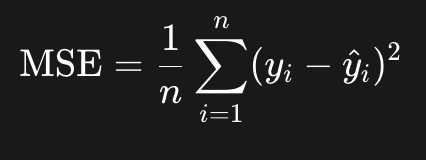

2. MSE (Mean Squared Error, 평균 제곱 오차)

✔ 특징

|

❗ 단점

|

✅ 사용 예시

|

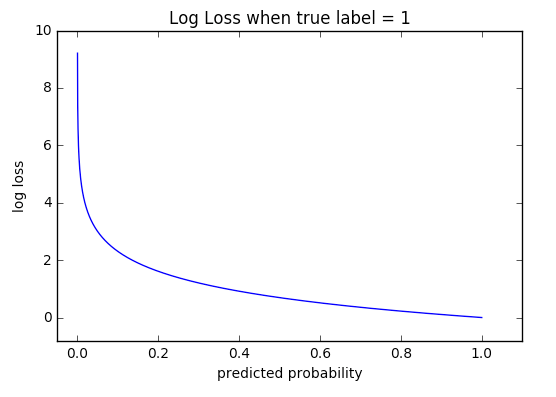

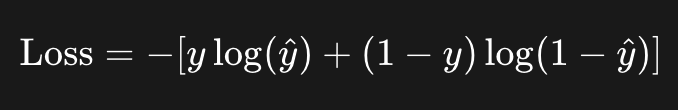

3. Cross-Entropy (교차 엔트로피)

✔ 특징

|

❗ 단점

|

✅ 사용 예시

|

4. 언제 어떤 손실 함수를 써야 할까?

| 문제 유형 | 추천 손실 함수 | 이유 |

| 숫자 예측(회귀) | MSE, MAE | 수치 예측에 적합, 오차 크기 기반 계산 |

| 이진 분류 | Binary Cross-Entropy | 0 또는 1 확률로 판단 필요 |

| 다중 클래스 분류 | Categorical Cross-Entropy | 여러 클래스 중 정답 확률 추정 |

| 불균형 데이터 분류 | Focal Loss | Cross-Entropy의 변형, 클래스 불균형 보완 |

5. 실제 비교 예시

정답(y) = 1, 예측값(ŷ) = 0.7일 때

| 손실 함수 | 계산 방식 | 손실 값 |

| MSE | (1 - 0.7)² = 0.09 | 0.09 |

| CE | -log(0.7) ≈ 0.3567 | 0.36 |

🔎 Cross-Entropy는 확률이 떨어질수록 손실이 훨씬 커지기 때문에, 모델에게 더 큰 경고를 줍니다.

6. 손실 함수 선택 시 유의점

- 손실 함수는 문제 유형 + 출력층 활성화 함수와 함께 고려해야 함

예: - 일부 손실 함수는 클래스 불균형이나 이상치에 민감할 수 있으므로 데이터 특성에 따라 조정 필요

7. 핵심 용어 요약 정리표

| 용어 | 정의 |

| 손실 함수 (Loss Function) | 예측값과 실제값의 차이를 수치로 표현 |

| MSE (평균 제곱 오차) | 수치 예측에서 오차를 제곱해 평균을 낸 값 |

| Cross-Entropy (교차 엔트로피) | 확률 기반 분류 문제에서 오차 측정용 |

| Binary Cross-Entropy | 0 또는 1을 예측하는 이진 분류용 손실 |

| Categorical Cross-Entropy | 다중 클래스 분류용 손실 함수 |

| Focal Loss | 불균형 분류 문제에서 Cross-Entropy 보완 버전 |

마무리 정리

- 손실 함수는 딥러닝 학습의 방향을 결정하는 핵심 요소입니다.

- 단순히 오차를 측정하는 것이 아니라,

"어떤 오차를 더 크게 패널티 줄 것인가?", "어떻게 학습을 유도할 것인가?"를 결정합니다.

💡 MSE는 회귀에, Cross-Entropy는 분류에!

이 두 가지만 확실히 구분해도, 모델 설계의 절반은 성공입니다.

https://jdcyber.tistory.com/100

딥러닝은 어떻게 학습할까? 순전파부터 NPU까지 한눈에 정리

이번 글에서는 딥러닝이 실제로 어떤 방식으로 작동하는지,그리고 왜 AI 전용 하드웨어인 NPU가 필요하게 되었는지까지를하나의 흐름으로 이해하고 싶은 분들을 위한 정리글입니다.https://jdcyber.

jdcyber.tistory.com

궁금하신 사항은 댓글에 남겨주세요

댓글에 남겨주신 내용은

추후 정리해서 올려드리겠습니다

구독하시면 업로드 시 알려드릴게요!

-

조금이라도 도움이 되셨다면

공감&댓글 부탁드리겠습니다

감사합니다!

'NPU' 카테고리의 다른 글

| 딥러닝 연산, 왜 GPU를 넘어서 NPU까지 필요할까? (5) | 2025.04.15 |

|---|---|

| 딥러닝은 어떻게 학습할까? 순전파부터 NPU까지 한눈에 정리 (0) | 2025.04.09 |

| 딥러닝의 핵심, 활성화 함수 (ReLU, Sigmoid, Tanh 차이와 선택 기준) (1) | 2025.04.09 |

| 뉴럴 네트워크란 무엇인가? (NPU 개념 공부) (1) | 2025.04.09 |

| 인공지능, 머신러닝(ML), 딥러닝(DL)의 관계 (2) | 2025.04.04 |